Produkte

-

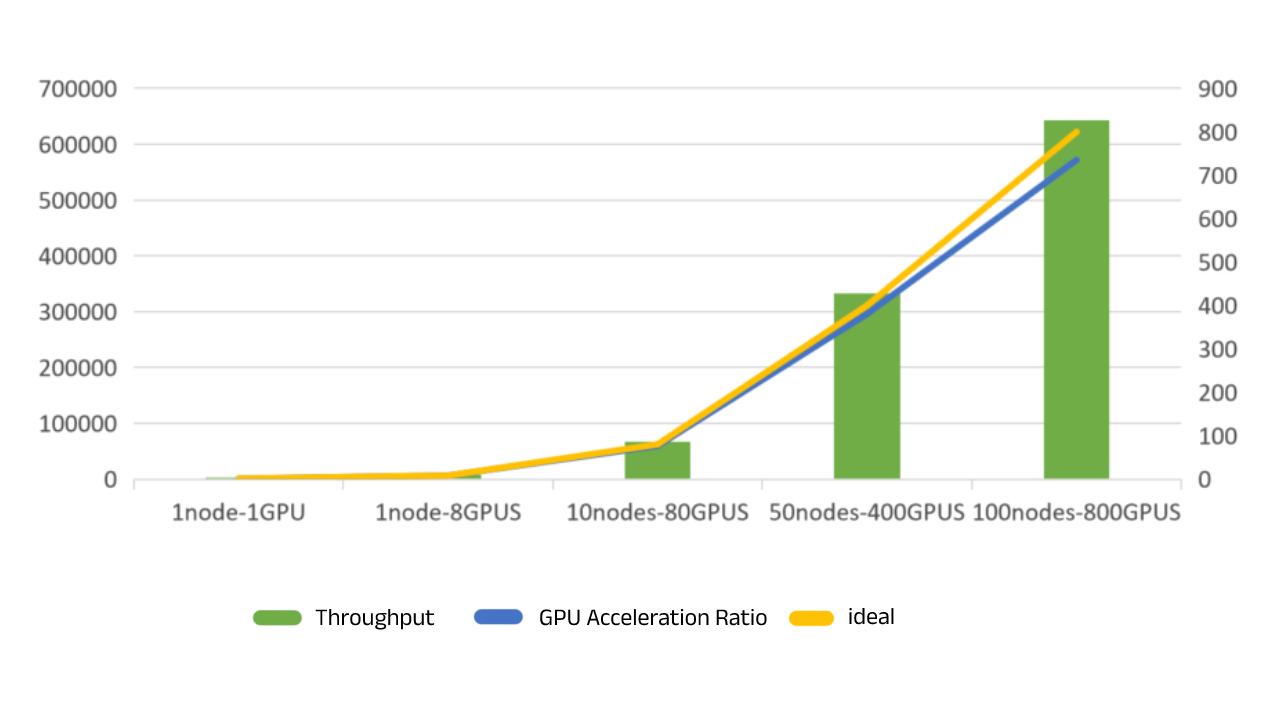

Full Stack KIMehr erfahren

LLM-Schulung, KI+Wissenschaft, Metaverse, Bild- und Spracherkennung, Verarbeitung natürlicher Sprache.

-

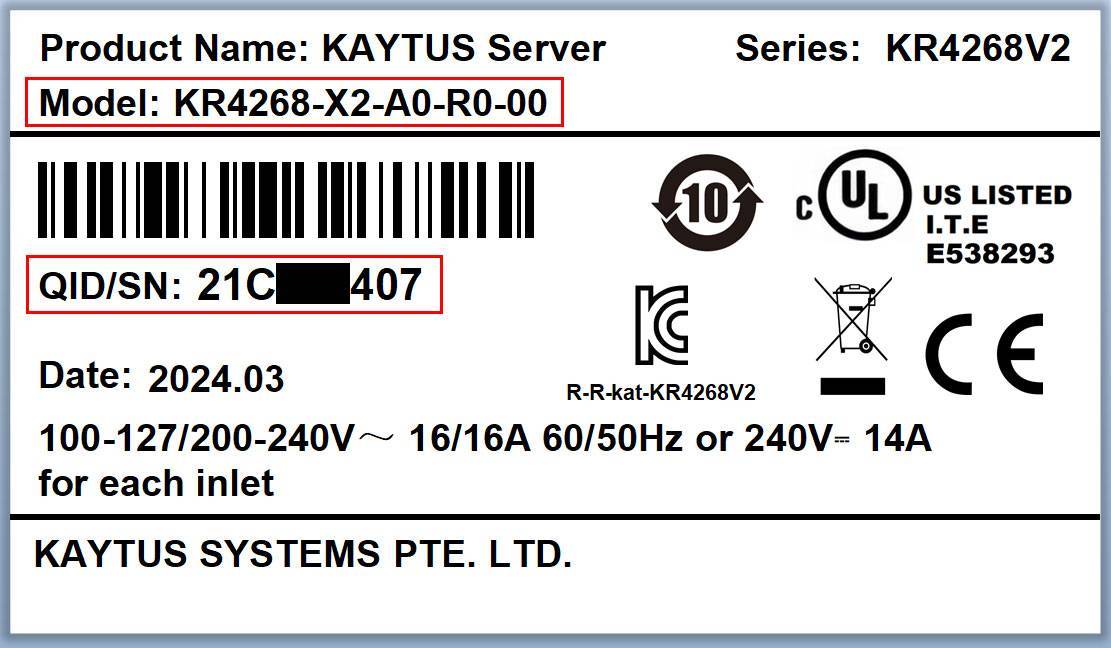

Rack- und Tower-ServerMehr erfahren

Cloud Computing,

Virtualisierung, Big Data, Videotranskodierung. -

Edge-ServerMehr erfahren

Intelligentes O&M, Qualitätsprüfung, Fehlerdiagnose, autonomes Fahren.

-

Multi-Node-ServerMehr erfahren

Das ultimative Leistungserlebnis und eine neue Generation von energiesparenden Rechenzentren mit hoher Dichte.

-

SpeicherMehr erfahren

Umfassendes Produktportfolio und Lösungen für alle Szenarien, Aufbau einer stabilen, zuverlässigen, intelligenten und effizienten Dateninfrastruktur

-

Cloud-InfrastrukturMehr erfahren

Virtualisierung, HCI, Full-Stack-RDMA, Millionen von IOPS, elastische Skalierung

-

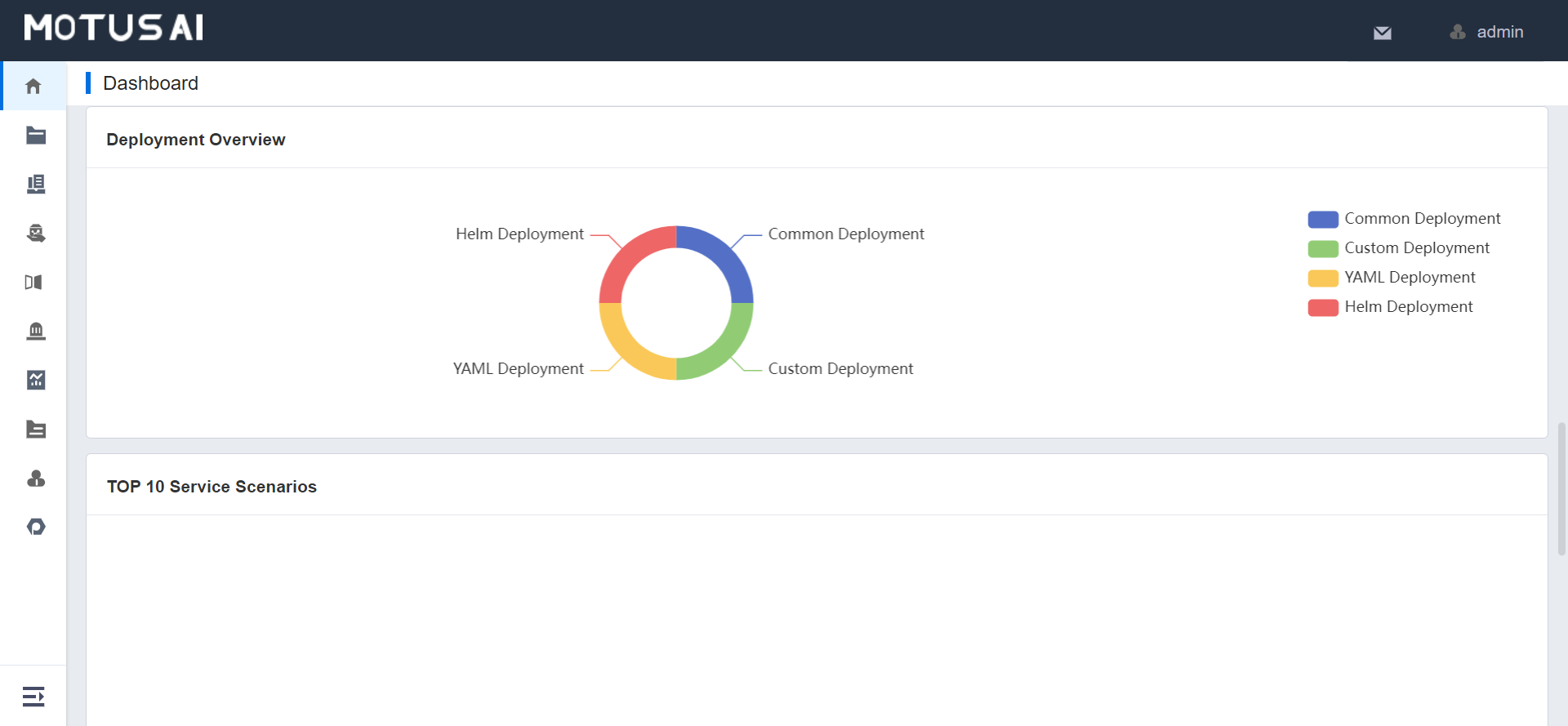

Management SuitesMehr erfahren

Servermanagement-Suite, Infrastrukturmanagement-Plattform, Online-Repository für Server-Firmware

Support

-

Support Center

-

Service Center

-

Online-Tools

Über uns

-

Über uns

-

News & Events

-

Sonstige Mittel

Kontakt

Kontakt